API для трекинга тела был опубликован в четверг в составе Movement SDK, который также включает API для трекинга глаз и API для трекинга лица на Quest Pro.

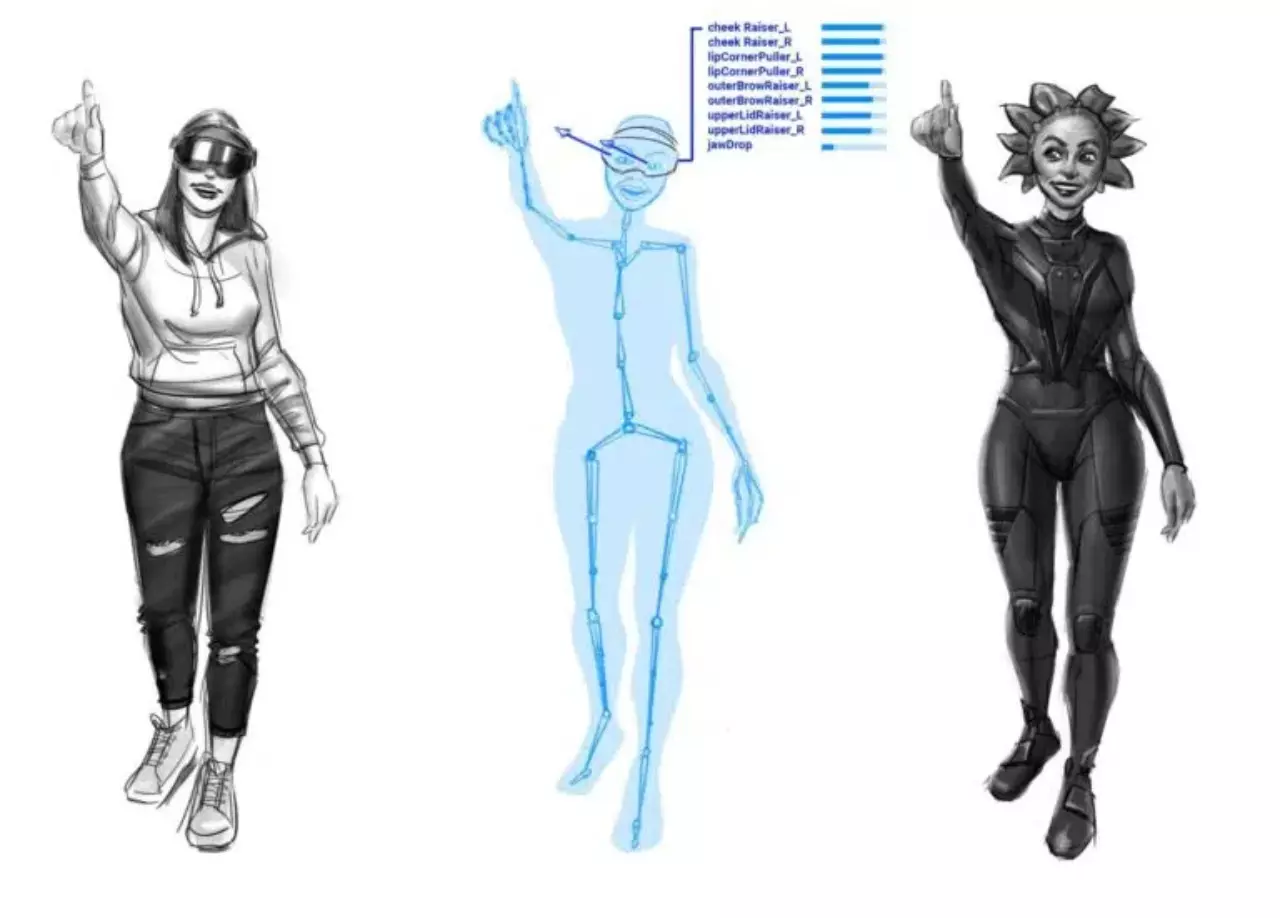

Официальный аккаунт Oculus Developers в Твиттере объявил о выпуске с иллюстрацией из документации, на которой показана вся форма тела пользователя. Иллюстрация получила широкое распространение, в результате чего многие решили, что Quest получил поддержку отслеживания корпуса, но и название API, и иллюстрация вводят в заблуждение.

В API отслеживания рук Meta обеспечивает фактическое положение ваших рук и пальцев, отслеживаемое камерами, установленными снаружи. API отслеживания глаз и API отслеживания лица предоставляет фактическое направление взгляда и движения лицевых мышц, отслеживаемые камерами Quest Pro, обращенными внутрь. Но API «Body Tracking» обеспечивает только «симуляцию скелета верхней части тела» на основе положения головы и рук, подтвердил представитель Meta в интервью UploadVR. Это не фактическое отслеживание, и оно не включает в себя отслеживание ног.

Более подходящим названием для API было бы «Оценка позы тела». Сотрудник компании описал технологию как сочетание инверсной кинематики (IK) и машинного обучения (ML). IK относится к классу уравнений для оценки неизвестных положений частей скелета (или робота) на основе известных положений. На этих уравнениях основаны все полнотелые VR аватары в современных приложениях. Разработчикам не нужно реализовывать (или даже понимать) математику, лежащую в основе IK, поскольку игровые движки, такие как Unity и Unreal, имеют встроенную IK, а пакеты, такие как популярный Final IK, предлагают полностью реализованный алгоритм менее чем за 100 долларов.

Если вы не используете оборудование для отслеживания тела, например, трекеры HTC Vive Trackers, IK для VR, как правило, будет неточной — существует просто множество потенциальных решений для каждого заданного набора положений головы и рук. Meta утверждает, что ее модель машинного обучения может создать более точную позу тела совершенно свободно. Демонстрационное видео, похоже, подтверждает это утверждение, хотя без нижней половины тела — и с поддержкой только гарнитур Quest — большинство разработчиков, вероятно, не захотят воспользоваться этой возможностью.

Однако намеки, сделанные на мероприятии Connect 2022 компании Meta, и исследования компании позволяют предположить, что в будущем ноги все-таки будут добавлены.

В своем выступлении для разработчиков менеджер по продукту трекинга тела Вибхор Саксена сказал:

«Новые улучшения в отслеживании тела будут доступны через тот же API в ближайшие годы, поэтому вы можете быть уверены, что будете продолжать получать лучшие технологии отслеживания тела от Meta без необходимости переходить на другой интерфейс.

Мы рады предоставить вам эти возможности и усердно работаем над тем, чтобы сделать отслеживание тела намного лучше в ближайшие годы.»

Во время основного выступления Марк Цукерберг объявил, что у Meta Avatars появятся ноги, продемонстрировав их, что также не соответствовало действительности. Ноги появятся в Horizon в конце этого года, а затем в SDK для других приложений уже в следующем году. Саксена подтвердил, что API Body Tracking использует ту же технологию, которая лежит в основе Meta Avatars — что, похоже, говорит о том, что и для API будут предусмотрены лапки.

Вы можете задаться вопросом: если Body Tracking API — это просто оценка, основанная на положении головы и рук, как он может включать ноги? В прошлом месяце компания Meta продемонстрировала исследование именно этого вопроса, используя последние достижения в области машинного обучения. Однако показанная система не является полностью точной и имеет задержку 160 мс — более 11 кадров при частоте 72 Гц. Это слишком медленно, а результат несовершенен, так что невозможно рассчитывать на то, что вы посмотрите вниз и увидите собственные ноги в том положении, в котором вы ожидаете их увидеть. Комментарии технического директора Meta позволяют предположить, что компания будет использовать подобную технологию для отображения ног на аватарах других пользователей:

«Наличие ног на вашем собственном аватаре, которые не соответствуют вашим реальным ногам, очень дискомфортно для пользователей. Но, конечно, мы можем показать ноги на других людях, которых вы можете видеть, и это вас нисколько не смутит.

Поэтому мы работаем над ногами, которые будут выглядеть естественно для стороннего наблюдателя — ведь он не знает, как на самом деле расположены ваши настоящие ноги, — но, вероятно, вы, глядя на свои собственные ноги, по-прежнему ничего не увидите. Такова наша нынешняя стратегия.»

Однако, как уже отмечалось в свое время, грядущее решение может оказаться не таким качественным, как это исследование. Работы по машинному обучению часто выполняются на мощных графических процессорах ПК при относительно низкой частоте кадров, и в статье не упоминалась производительность системы, о которой идет речь.